La nascita dell’Intelligenza Artificiale viene ufficialmente fatta risalire all’avvento dei computer, nel 1956 (anche se fu teorizzata qualche anno prima da Alan Turing (link alla timeline) nella rivista Computing Machinery and Intelligence. Può essere definita come quel ramo dell’informatica che abilita in una macchina capacità computazionali e logiche solitamente considerate tipiche del genere umano, come la capacità decisionale, la percezione spazio-temporale dell’ambiente in cui la macchina si trova e la capacità di riconoscere immagini ed oggetti. A permetterlo sono la programmazione e la progettazione sia a livello hardware che software.

La macchina va dunque oltre la semplice capacità di calcolo o di riconoscimento/elaborazione dei dati, ma mostra esempi di altre forme di “intelligenza”, come quelle indicate da Howard Gardner nel suo saggio “Frames of Mind” nel 1983. La sua Teoria delle Intelligenze Multiple si basa sull’idea che tutti gli esseri umani possiedano almeno sette forme di “rappresentazione mentale”, dall’intelligenza spaziale a quella sociale, da quella cinestetica a quella introspettiva. Le macchine che nascono in ambito AI sono in grado di riprodurre proprio queste tipologie di intelligenze.

Più recentemente, la Commissione Europea tramite il suo team dedicato (vedi box) ha proposto questa definizione (aprile 2018):

● L’intelligenza artificiale (AI) si riferisce a sistemi che mostrano un comportamento intelligente e che sono in grado di analizzare il loro ambiente e intraprendere azioni – con un certo grado di autonomia – per raggiungere obiettivi specifici.

● I sistemi di intelligenza artificiale possono essere puramente software (ad es. Assistenti vocali, software di analisi delle immagini, motori di ricerca, sistemi di riconoscimento vocale e facciale) o AI integrati in dispositivi hardware (ad es. robot avanzati, auto autonome, droni o sensori intelligenti).

● Reasoning and Decision Making

● Learning

● Robotics

| Sensori per la percezione dell’ambiente | Ad esempio fotocamere, microfoni, una tastiera o altri dispositivi di input, nonché sensori fisici per misurare ad esempio temperatura, pressione, distanza. Ad un sistema di AI occorrono sensori adeguati per percepire i dati presenti nell’ambiente che risultano rilevanti per l’obiettivo assegnato. |

| Algoritmi di elaborazione e algoritmi decisionali | I dati che sono stati catturati dai sensori vengono processati dal modulo di ragionamento della AI, che li utilizza per compiere l’azione corretta in base all’obiettivo da raggiungere. I dati diventano informazioni. |

| Attuazione della decisione | Decisa l’azione, il sistema AI attiva gli attuatori a sua disposizione, non solamente fisici ma anche software. Bisogna considerare che i sistemi di intelligenza artificiale razionale non è detto che scelgano sempre l’azione migliore per il proprio obiettivo, a causa di limitazioni nelle risorse come il tempo o la potenza di calcolo. |

A livello comunitario europeo è stato istituito nel 2017 l’High-Level Expert Group on Artificial Intelligence (AI HLEG). L’obiettivo generale del gruppo dei 52 esperti di alto profilo dell’intelligenza artificiale è sostenere l’attuazione della strategia europea sul tema. Tra i task inclusi c’è l’elaborazione di raccomandazioni sullo sviluppo di politiche relative al futuro dell’AI e questioni etiche, legali e sociali.

Scopri di piùL’uomo, nella letteratura e nel cinema, si è sempre posto domande sulla possibile interazione con un’intelligenza artificiale. Il primo personaggio di finzione ad essere considerato tale è il Frankenstein di Mary Shelley (1818), divenuto film nel 1931. Non una creatura di metallo e silicio, come siamo abituati a immaginare oggi, ma un essere non umano riportato in vita grazie a prodigi tecnologici, che scopre il libero arbitrio e combatte per ottenerlo sfidando il suo stesso creatore.

È un concetto che ritroviamo in molte opere successive, a partire dal dramma ceco di Karel Čapek “RUR” del 1920. Robota in ceco significa lavoro: le “macchine” costruite per sostituirci nei lavori più pericolosi e pesanti, finiscono per divenire sempre più intelligenti e apprendere non solo nozioni e azioni ma anche sentimenti. La discriminazione, la paura e l’insensibilità umana sono spesso il motivo delle loro ribellioni.

Isaac Asimov, considerato uno dei capostipiti della letteratura di fantascienza aveva delineato le tre leggi della robotica:

1 – Un robot non può recar danno a un essere umano né può permettere che, a causa del proprio mancato intervento, un essere umano riceva danno.

2 – Un robot deve obbedire agli ordini impartiti dagli esseri umani, purché tali ordini non contravvengano alla Prima Legge.

3 – Un robot deve proteggere la propria esistenza, purché questa autodifesa non contrasti con la Prima o con la Seconda Legge.

Queste leggi sono valide a meno che, scrive Asimov nei suoi libri, non contrastino con la Legge Zero: Un robot non può danneggiare l’Umanità, né può permettere che, a causa del suo mancato intervento, l’Umanità riceva danno.

Impossibile citare tutte le suggestioni letterarie e cinematografiche relative al tema. Quelle che seguono sono 3 tra le tipologie di intelligenze artificiali più viste nel cinema. Una lista esaustiva per cinefili la potete trovare qui.

Una ricerca dell’Osservatorio Artificial Intelligence della School of Management del Politecnico di Milano mostra come il 96% delle imprese italiane che hanno già implementato soluzioni di AI nelle proprie attività non rileva effetti di sostituzione del lavoro umano da parte delle macchine.

L’intelligenza artificiale entra in gioco più di quanto pensiamo nella vita quotidiana delle persone. Nel campo della medicina, ad esempio, si fa ricorso sempre di più al digital per la diagnostica di malattie come il Parkinson e l’Alzheimer, ma anche in campi apparentemente intoccabili come l’arte è successo che un dipinto generato dall’AI nell’ottobre 2018, fosse battuto da Christie’s a oltre 430000 dollari. E se siamo abituati (consapevoli?) ad essere guidati nelle nostre esperienze di acquisto (Amazon & C.) e di visione (Netflix su tutti), faremo l’abitudine a gestire i nostri investimenti finanziari grazie al servizio di caring gestito da forme di intelligenza artificiale, come ad esempio l‘assistente Erica della Bank of America.

L’abbinamento dei termini “Strong” e “Weak” con Intelligenza Artificiale è stato creato da John Searle, che voleva sottolineare differenti livelli di prestazioni in diversi tipi di macchine.

| IA Debole | IA Forte |

| Una piccola applicazione con un obiettivo limitato. | Applicazione più ampia con una portata più vasta. |

| Applicazione buona per specifici compiti. | Questa applicazione ha un’intelligenza a livello dell’uomo. |

| Utilizza l’apprendimento supervisionato dall’uomo e non per elaborare dati. | Utilizza il clustering e l’associazione per elaborare dati. |

| Esempio: Assistenti vocali | Esempio: Robotica avanzata |

Narrow AI

Sono sistemi progettati per risolvere un singolo problema. Per definizione, hanno capacità limitate: possono consigliare un prodotto di e-commerce o fornire previsioni del tempo. Sono in grado di avvicinarsi al comportamento umano, ma possono eccellere solo in ambienti con un numero limitato di parametri.

General AI

È il tipo di Intelligenza Artificiale più vicino a quella umana. Alcuni scienziati sostengono che sia prossima a vedere la luce una AI in grado di relazionarsi all’ambiente sociale nello stesso modo in cui lo farebbe un essere umano. Il gap attuale è rappresentato non dalla capacità di analisi e dall’elaborazione dei dati (in cui sono già enormemente superiori a noi), ma dall’impossibilità di pensare in modo astratto e di avere idee originali.

Super AI

Teoricamente supera l’intelligenza umana in modi che non possiamo attualmente nemmeno immaginare. Una super AI sarebbe migliore di noi in tutto, ma qui si entra nel territorio della fantascienza, Le sue capacità comprenderebbero processi decisionali, decisioni razionali e anche la costruzione di relazioni emotive.

Il Machine Learning è la scienza che permette alle macchine di interpretare, elaborare e analizzare i dati per risolvere i problemi del mondo reale. A un livello base, il ML significa fornire dati a un computer per allenarlo a svolgere un task: la macchina – l’algoritmo – migliora le proprie prestazioni sulla base dei dati che le vengono forniti.

La maggior parte dell’apprendimento automatico richiede un input costante da parte degli esseri umani e viene alimentata con set di dati per lo più etichettati, sebbene esistano anche algoritmi non supervisionati.

In Machine Learning ci sono tre categorie:

- Apprendimento supervisionato

- Apprendimento senza supervisione

- Insegnamento rafforzativo

Il Deep Learning è una versione superiore del Machine Learning che può, all’interno di un ambiente reale, apprendere per livelli di astrazione.

Come esempio più eclatante, si ricorda Sophia, l’androide in grado di riprodurre oltre 60 espressioni facciali umane e in grado di partecipare a dibattiti di alto profilo.

La robotica è una branca dell’intelligenza artificiale che si concentra su diversi rami e applicazioni di robot. I robot AI sono agenti artificiali che agiscono in un ambiente reale per produrre risultati intraprendendo azioni responsabili.

Sophia l’umanoide è un buon esempio di intelligenza artificiale nella robotica.

Un Expert System è un sistema informatico basato sull’Intelligenza Artificiale in grado di imparare le capacità decisionali di un umano esperto e di replicarle.

Un ES utilizza notazioni basate sulla logica if-then per arrivare a risolvere problemi complessi; non si basa, quindi, sulla programmazione procedurale convenzionale. Tra i principali campi di applicazione di questa branchia di AI, ci sono l’analisi prestiti, il rilevamento di virus, la gestione delle informazioni e le attività di strutture mediche.

La Fuzzy logic (“logica sfocata”) può essere vista come un’evoluzione della logica booleana dello “0-1”, A differenza di quest’ultima, infatti, è un approccio informatico basato sui principi dei gradi di verità (“degrees of truth”) ed è quindi in grado di affrontare anche contesti ambigui. La FL è usata, ad esempio, in ambito medico per risolvere problemi complessi che riguardano il processo decisionale, ma anche nel controllo ambientale per la guida automatica del veicolo o, sempre sulle vetture, per la gestione del cambio automatico.

Natural Language Processing (NLP) si riferisce alla scienza di trarre intuizioni dal linguaggio umano naturale al fine di comunicare con le macchine e far crescere le imprese.

Twitter utilizza la NLP per filtrare il linguaggio terroristico nei suoi tweet, Amazon utilizza la PNL per comprendere le recensioni dei clienti e migliorare l’esperienza dell’utente.

Dalle statistiche più recenti, risulta che a livello mondiale, i finanziamenti complessivi nel campo dell’Intelligenza Artificiale siano rivolti soprattutto alla realizzazione di applicazioni e di piattaforme di Machine Learning (quasi 28,5 miliardi di dollari a metà 2019). L’attuale scenario è ancora all’interno della Narrow AI.

Ma che cosa succederà nel futuro prossimo, quando cominceranno a svilupparsi forme di AGI (Artificial General Intelligence) e ASI (Artificial Super Intelligence)?

A differenza di quanto si potrebbe pensare, condizionati da un immaginario “cinematografico”, l’attuale interesse di business del settore non è focalizzato su robot di compagnia o al servizio delle nostre attività quotidiane. Il settore che maggiormente sta spingendo il mondo dell’AI è attualmente quello del Riconoscimento, classificazione ed etichettatura di immagini statiche (8 miliardi di dollari), seguito dal Miglioramento delle prestazioni della strategia di trading algoritmico” (7,5 miliardi di dollari) e dall’Elaborazione efficiente e scalabile dei dati dei pazienti (7,4 miliardi di dollari). Almeno fino al 2025, lo scenario sarà un po’ meno futuristico e più “applicativo”.

Intervista con Gianluca Toscano, Technology Leader Teoresi Group (dicembre 2020)

Intervista con Gianluca Toscano, Technology Leader Teoresi Group (dicembre 2020)

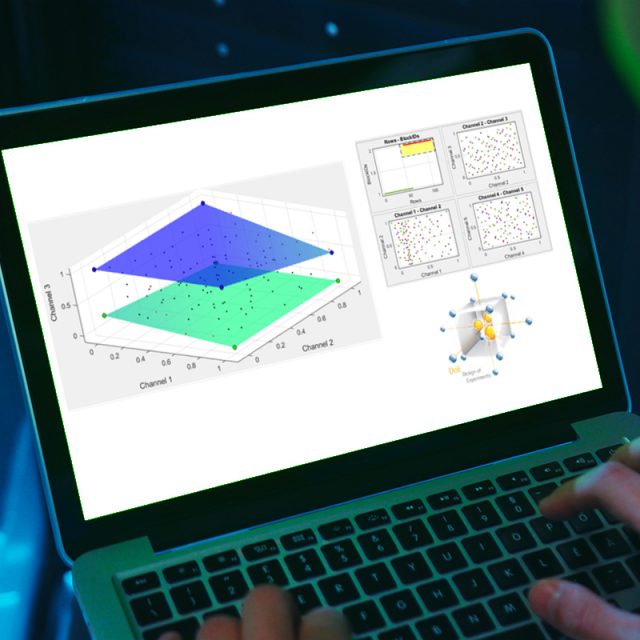

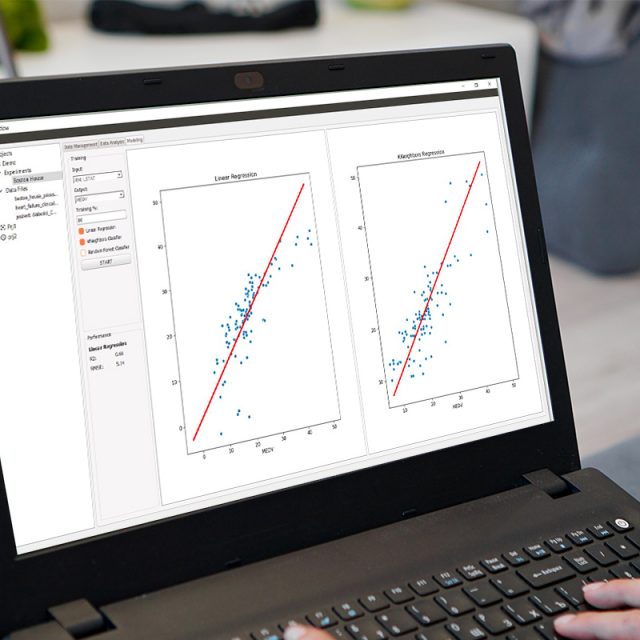

Questo software può produrre piani di acquisizione sperimentale ridotta, utilizzando un approccio di «riempimento dello spazio», e costruire modelli basati su tali acquisizioni per simulare misurazioni reali che abbracciano tutto il dominio di interesse.

• Per i sistemi complessi (ad esempio il controllo di un motore) sono preferibili tecniche di riempimento dello spazio

• In questo caso particolare abbiamo utilizzato sequenze di Sobol

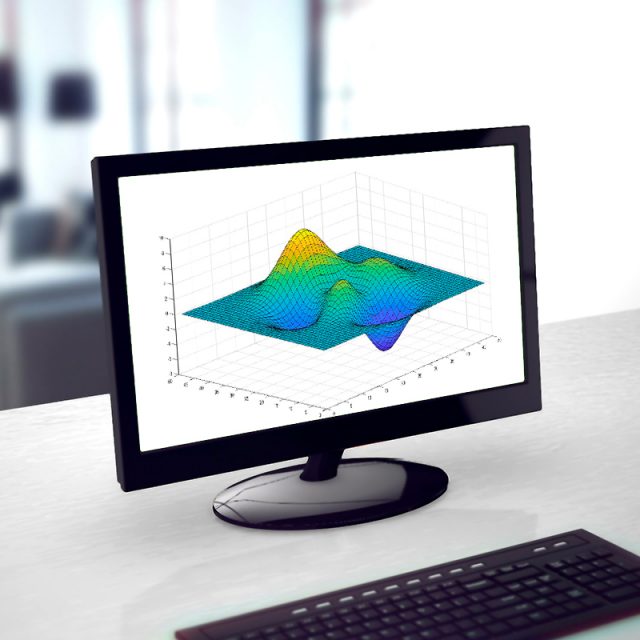

E’ un software che modella il processo fisico, mediante tecniche di regressione del processo gaussiano, e utilizza i dati misurati per:

• Comprendere meglio un fenomeno fisico

• Ingrandire un set di dati creando misurazioni virtuali

E’ un software per l’ottimizzazione matematica, basata su algoritmi genetici, di modelli software generici. Lo scopo principale del software è consentire all’utente di ottimizzare i parametri di un modello Simulink selezionato.

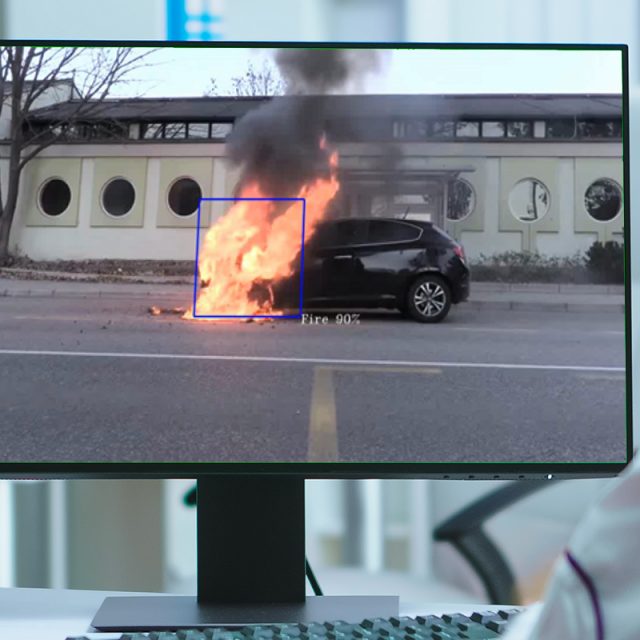

Il progetto è relativo alla realizzazione di un software integrato a bordo veicolo per l’interazione con i dati veicolari (Bus CAN ecc.) e per la visualizzazione su HW dedicato degli eventi ricevuti. è stato sviluppato inoltre un componente per centro servizi per la gestione delle immagini con tecnologie di computer vision.

Gitral è un software Teoresi che permette di riconoscere tutti gli oggetti tipici presenti su un cluster, o più in generale su un HMI, a partire dagli screenshot presi da telecamere ad alta risoluzione. Gitral è in grado di rilevare:

– Icon / TellTale Status e frequenza

– Livello e posizione del grafico a barre

– Testo e numero

– Gauge position

Lo strumento è utile ad esempio in ambiente HIL (Hardware In the Loop) per automatizzare il piano di validazione di software HMI.

Infine il protocollo CAN, tramite messaggi specifici, o il protocollo socket può essere utilizzato per comunicare con Gitral, quando richiesto.